Grande tecnologia versata Innumerevoli dollari e risorse in AIEcco un promemoria che gli algoritmi possono insegnare al Vangelo della sua luminosità utopica-visibile. Grande tempo. Ultime prove: puoi ingannare Panoramica dell’IA di Google .

Secondo la panoramica dell’IA di Google (di @egregionr bluesky), “Non puoi premere due volte il tasso” significa che non puoi ingannare o ingannare qualcuno una seconda volta dopo essere stato ingannato.

Sembra un tentativo logico di descrivere l’ideale, se non è papavero. Il fallimento dei gemelli di Google è progettato per ingannare la domanda che suggerisce una frase stabilita rispetto all’assurdo Jumbo Mumbo. In altre parole, AI allucinazioni Sono ancora vivi.

Abbiamo inserito un po ‘di intelligenza e abbiamo trovato risultati simili.

La risposta di Google è che “non puoi golf senza pesce” sta giocando su un groviglio o su un groviglio, non puoi giocare a golf senza l’attrezzatura necessaria, in particolare la pallina da golf. Divertente, l’IA ha aggiunto una clausola secondo cui la pallina da golf può essere “vista come” pesce “per la sua forma. Hmm.

Poi c’è un vecchio proverbio che “non puoi aprire il barattolo di burro di arachidi con due piedi sinistra”. Secondo la panoramica dell’IA, ciò significa che non puoi fare qualcosa che richieda abilità o efficienza. Ancora una volta, la presenza del contenuto è un’ottima pugnalata al lavoro assegnato a verificare effettivamente.

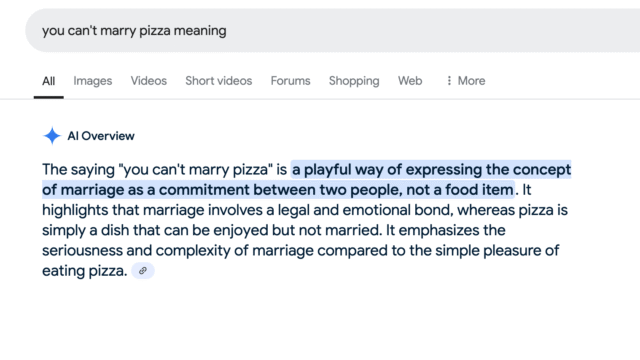

Ce ne sono così tanti altri. “Non puoi sposare la pizza” è un modo giocoso per esprimere il concetto di matrimonio come impegno tra due persone, non un oggetto alimentare. . Ciò richiede la volontà o il progresso naturale per cooperare. . (Consigli saldi.)

Questo non è il primo esempio di intelligenza artificiale, se il consumatore non viene effettivamente verificato, può portare a false informazioni o conseguenze della vita reale. Chiedere Avvocati di ChatgptSteven Squartz e Peter caricarono, loro Una multa di $ 5.000 nel 2023 Per l’uso di CHATGPT per indagare brevemente il contenzioso del cliente. La coppia ha prodotto casi di citazione dell’IA Chatbat d’altra parte che gli avvocati (molto comprensibili) non possono identificare.

La risposta di questa coppia al giudice disciplina? “Abbiamo sbagliato in buona fede nel credere che la parte della tecnologia stia facendo casi da tutto il tessuto”.

Questo articolo è apparso per la prima volta su Engadget https://www.engadget.com/ai/you-can-can-trick-googles-i-ii-ii-ii-ii-ii-ii-ii-ii-ii-ii-ii-ii-ii-ii-ii-ii-ii-ii-ii-Plainence-made-IDioms-162816472.html? SRSSSS.

Source link